【Google Cloud Next '26 in Las Vegas現地参加レポート】個別セッション:GKEで構築する次世代AIプラットフォームでハードウェア効率と開発速度を両立する

はじめに

Re:Q Techブログをご覧いただきありがとうございます。

クラウド&ネットワーク技術統括部のN.Tです。

皆さんは、AIの開発環境と聞いてどのようなイメージをお持ちでしょうか?

私自身、実はAI開発そのものを専門としているエンジニアではありません。

しかし、クラウドやネットワークを支える立場から今回のセッションを聴講し、最近のAI開発をスムーズに進めるためには、単に「高性能なGPUサーバーを用意する」だけでは解決できない大きな課題があることに改めて気づかされました。

GPUは非常に高価で貴重なリソースです。

そのため、現場では「リソースの奪い合い」が起きたり、逆に誰も使っていない「もったいない時間」が発生してしまったりといった、インフラ管理上の悩みが多く存在します。

こうした課題を解決し、研究者がインフラの複雑さに悩むことなく開発に集中できる環境を整える。

それが、今回ご紹介する「プラットフォーム・エンジニアリング」という考え方です。

今回の記事では、Google Cloud Next '26のセッション「Platform engineering for AI: Architect a unified stack on GKE」で得られた知見をベースに、インフラエンジニアの視点から「AI開発を支える理想の土台」について整理してみたいと思います!

1. 結論:GKEをAIの「OS」として統合する

セッションの核となっていたのは、AI開発の規模が拡大するにつれ発生する複雑性を、GKEを中心とした3層のスタックモデルで解決するという提案でした。

インフラを一つの「統合されたAI OS」として抽象化することで、ハードウェアの性能を最大限に引き出しつつ、開発者には使い慣れたツールを提供し続ける。

これが、これからのAIプラットフォームの目指すべき姿であると強調されていました。

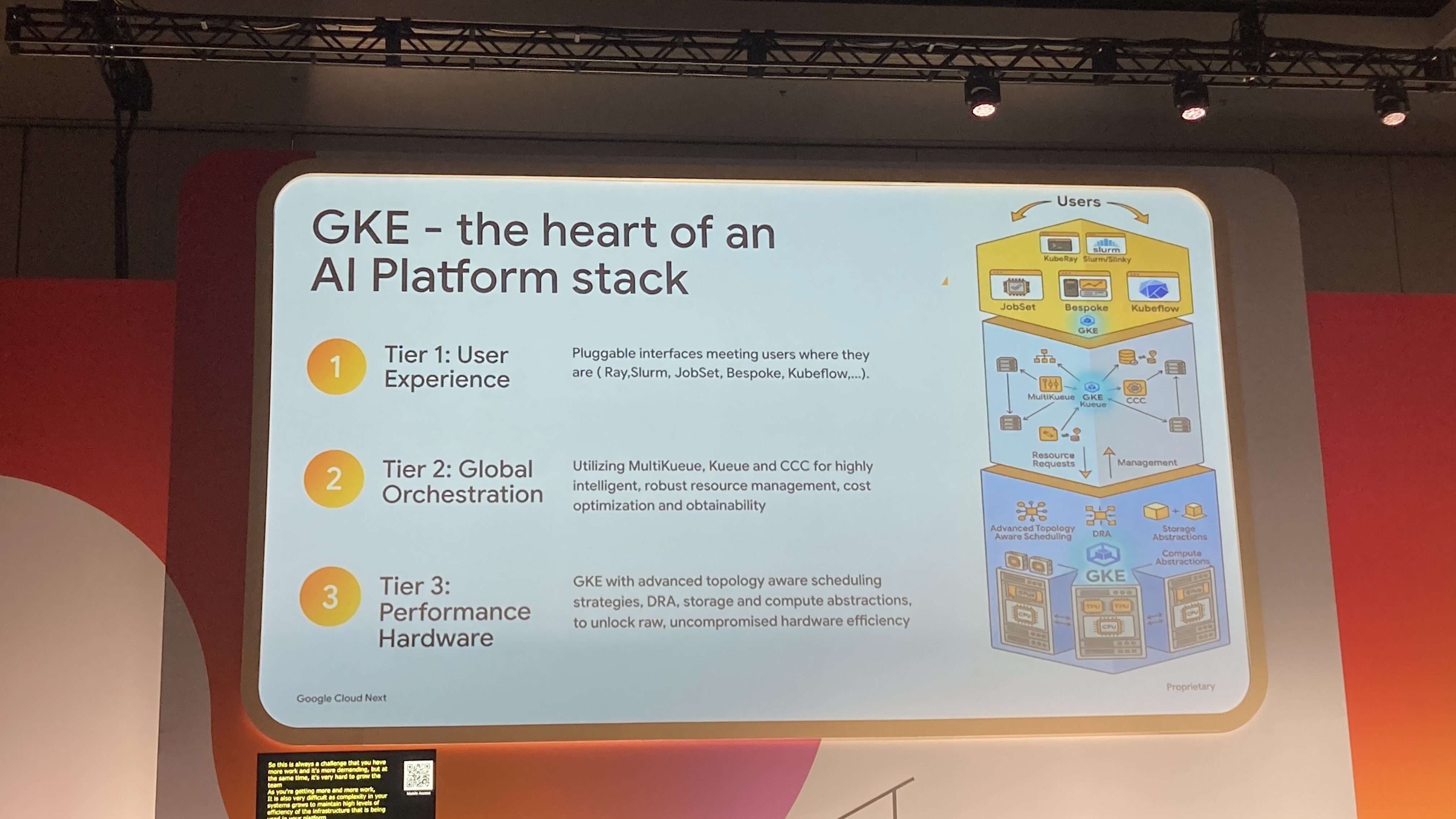

2. 3層構造のAIプラットフォーム・スタック

セッションで提案された3層構造(Tier 1〜3)は、インフラエンジニアにとっても非常に整理しやすいモデルでした。

| 階層 | 名称 | 役割と特徴 |

|---|---|---|

| Tier 1 | User Experience (UX) | 研究者が慣れ親しんだ Ray, Slurm, Notebooks などを、そのまま使える窓口として提供します。 |

| Tier 2 | Global Orchestration | Kueue や MultiKueue を使い、複数のクラスター全体で「誰がいつ、どれだけリソースを使うか」を賢く制御します。 |

| Tier 3 | Performance Hardware | ハードウェアの物理的な配置まで考慮し、GPUの性能を極限まで引き出すための土台です。 |

インフラの立場としては、この3層を意識した設計が、運用の効率化にも直結すると感じました!

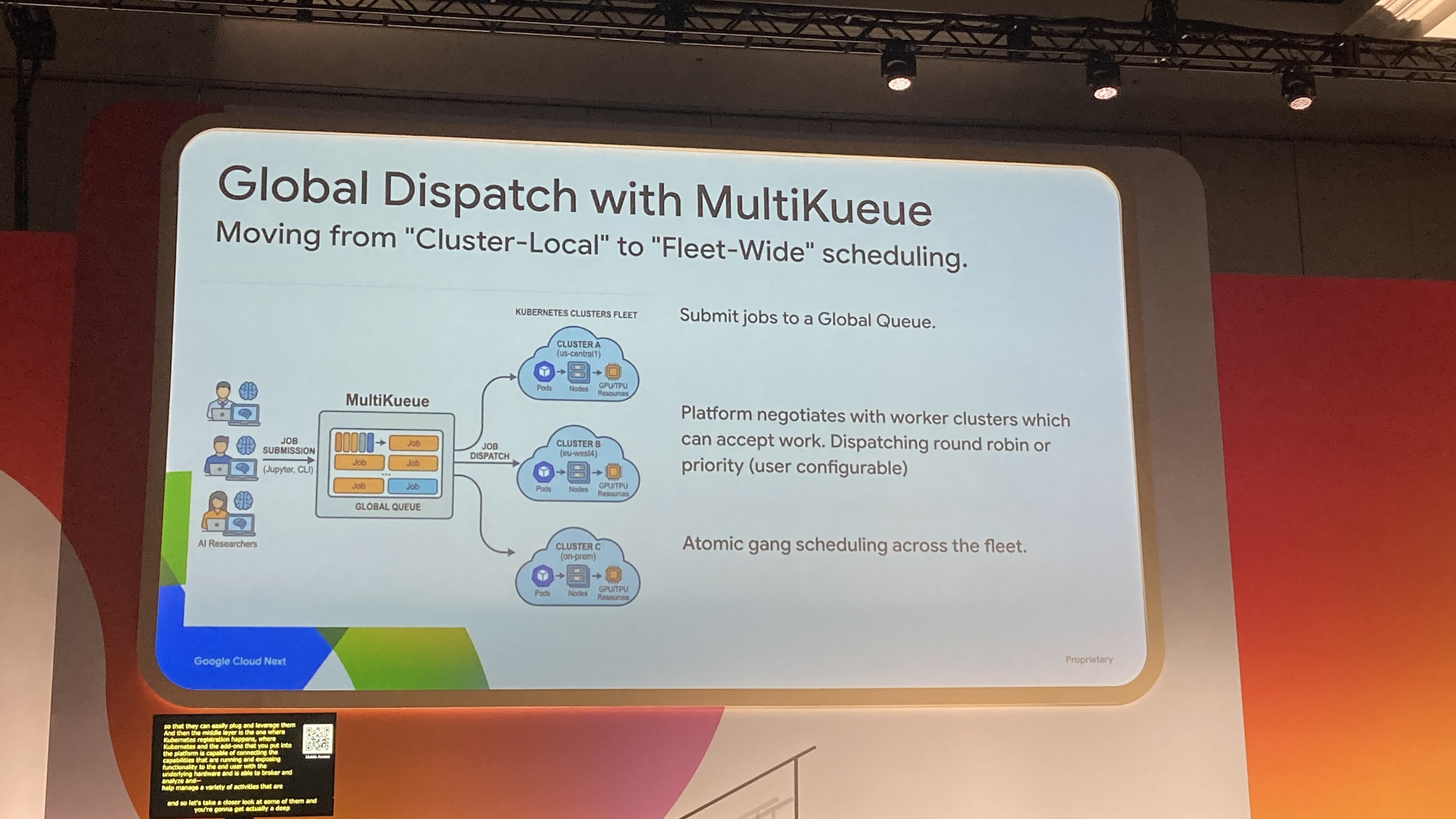

3. ジョブ管理の要:KueueとMultiKueue

「高価なリソースをいかに効率よく回すか」という問いに対し、セッションでは Kueue と MultiKueue の重要性が語られました。

- MultiKueue: 複数のクラスターを「一つの大きなプール」として扱い、ジョブを空いている場所へ自動で振り分けます。

- Kueue: クラスター内部で「優先順位」に基づいたリソースの割り当てや、無駄をなくすための制御を行います。

これらは、まさにインフラ管理者が欲しかった「賢い交通整理」の仕組みと言えますね。

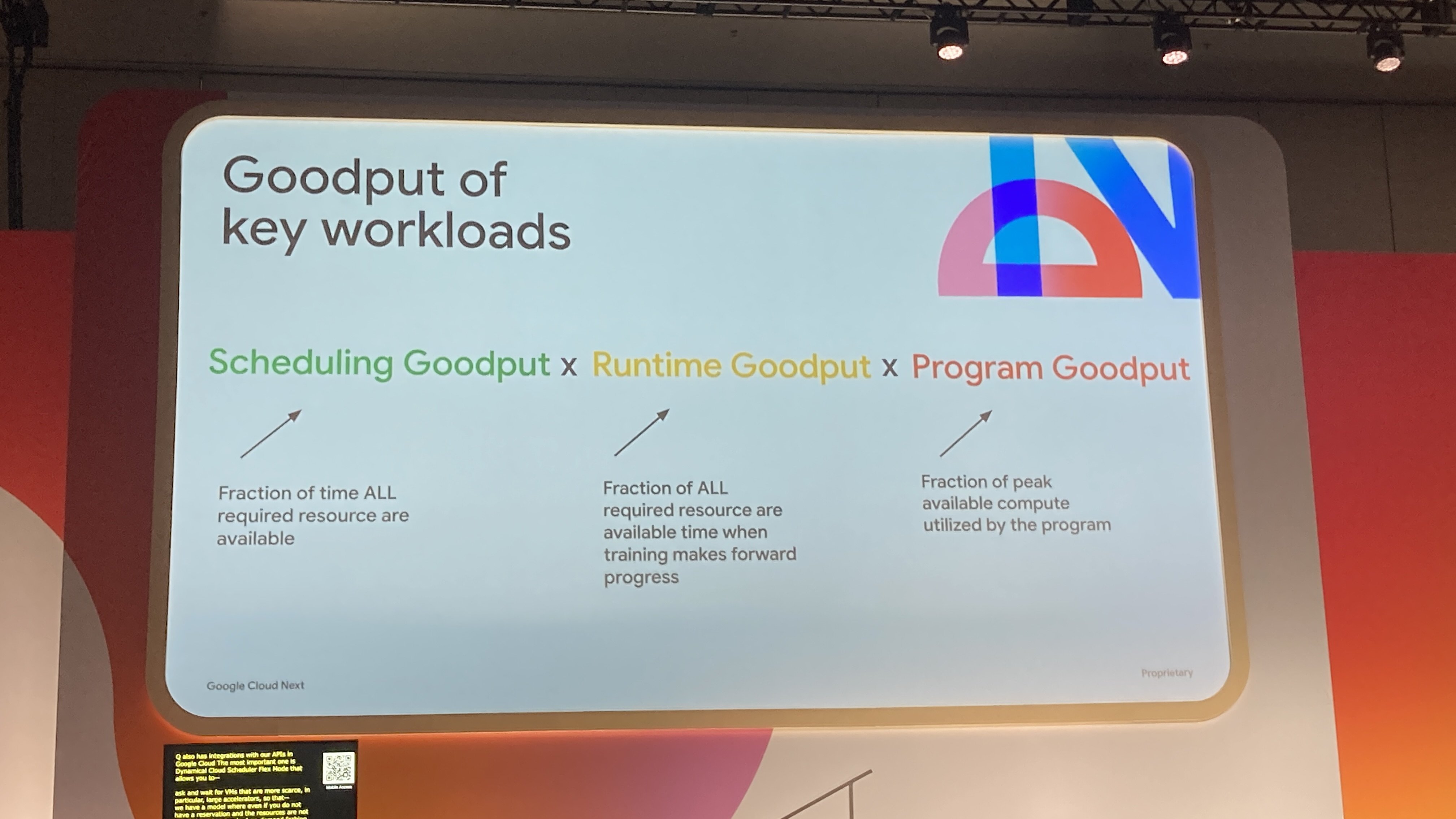

4. AIトレーニングの進捗を測る「Goodput」

特に興味深かったのが、GPUの稼働率(どれだけ動いているか)ではなく、学習の真の進捗(どれだけ成果が出ているか)を測る「Goodput」という指標です。

インフラ側でリソースを確保できても、実行が不安定だったり計算効率が悪ければ、高価なGPU代が無駄になってしまいます。

GKEでは、Multi-Tier Checkpointing などの機能によって、この「無駄」を最小限に抑える工夫がなされています。

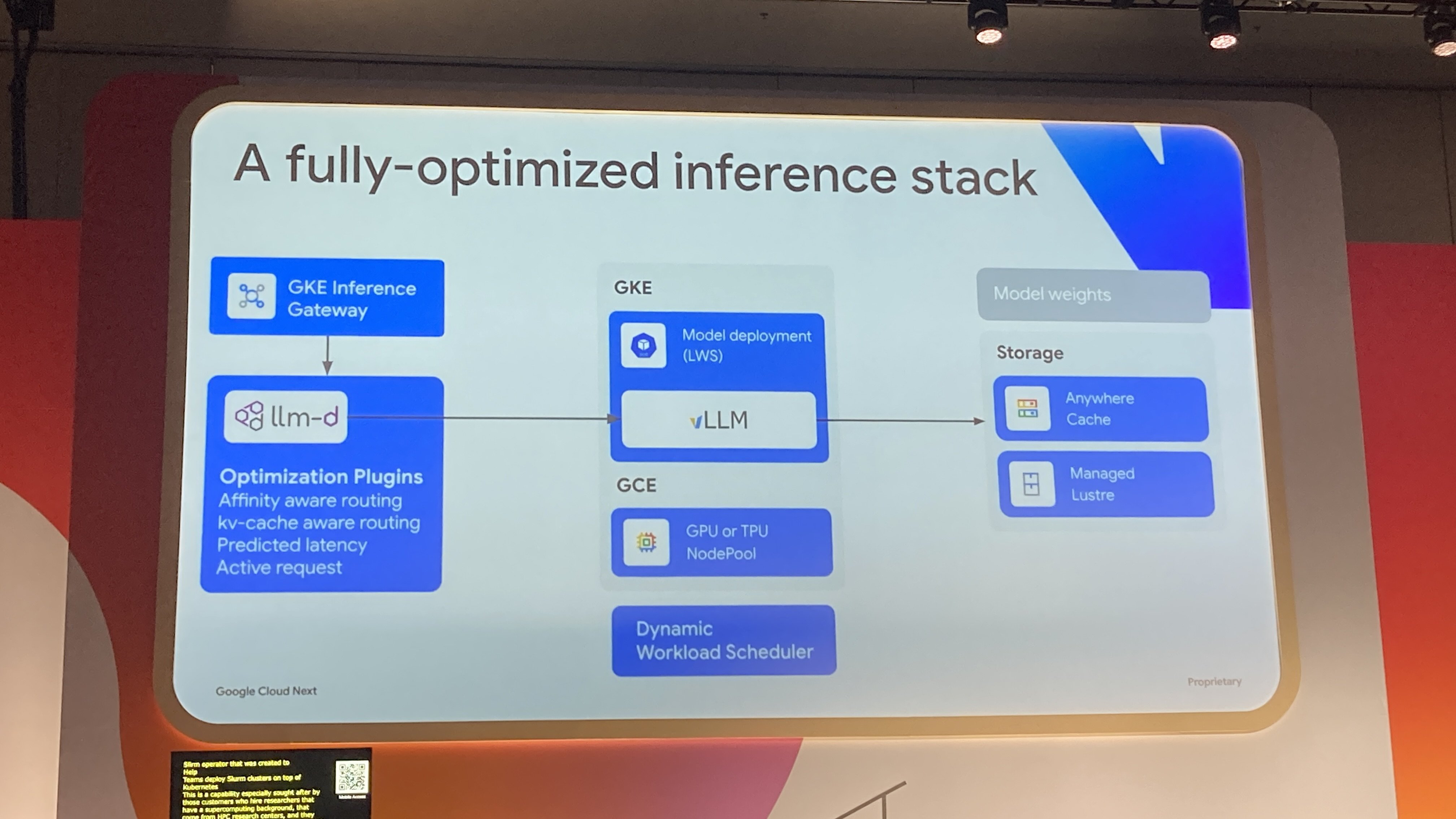

5. 推論の最適化:GKE Inference Gateway

推論環境についても、インフラのレイヤーで解決できる最適化手法が多数紹介されました。

GKE Inference Gateway を使えば、キャッシュ効率を高めるルーティングや、巨大なモデルのマルチノード展開が容易になります。

開発者に負担をかけず、インフラ側でパフォーマンスを底上げできる点が非常に魅力的です。

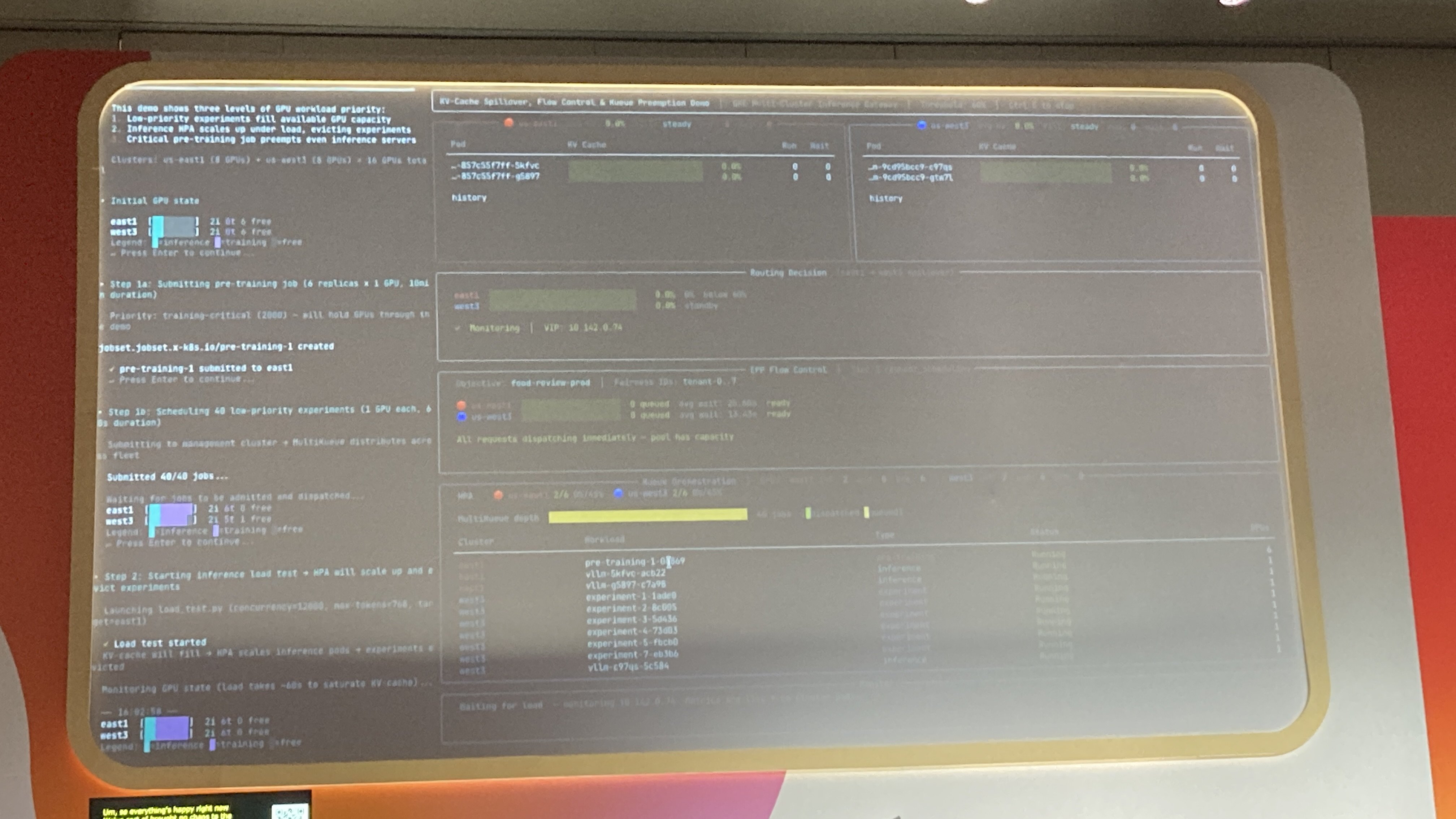

6. デモ:優先度によるダイナミックなリソース管理

デモでは、ビジネス上の優先度が高いジョブが入ってきた際、実行中の低いジョブを自動で一時停止させ、リソースを即座に明け渡す様子が実演されました。

こうした「自動的な優先順位付け」は、手動での調整が難しい大規模環境において、インフラ運用の鍵になると感じました!

さいごに

今回のセッションを通じて、GKEが単なるコンテナの器ではなく、AI開発を支える「強力な土台」へと進化していることを強く実感しました。

私のような非AIエンジニアであっても、インフラの視点からAI開発の課題を理解し、GKEの機能を活用することで、チームの開発効率を劇的に向上させる手助けができるはずです。

AIプラットフォームの構築に携わるインフラ担当の方は、ぜひこれらの機能を検討してみてはいかがでしょうか。

RELATED ARTICLE関連記事

2026.04.24

【Google Cloud Next '26 in Las Vegas現地参加レポート】Developer Keynote レポート

- GCP

- クラウド

- セキュリティ

- 生成AI

2026.04.24

【Google Cloud Next '26 in Las Vegas現地参加レポート】Opening Keynote レポート

- GCP

- クラウド

2026.04.23

【Google Cloud Next '26 in Las Vegas現地参加レポート】海外カンファレンス初参加!インフラ女子が見るGoogle Cloud Next '26 in ラスベガス

- Databricks

- GCP

- クラウド

- 生成AI