【Google Cloud Next '26 in Las Vegas現地参加レポート】エンタープライズにおけるクラウドコストの可視化と自律的なFinOpsの実装戦略

目次

1. はじめに

DE部T.Sです。

Google Cloud Next ‘26 in Las Vegasレポート3つ目。今回は前々回のROIの内容に通ずるものもありますが、より現場で開発を担うエンジニアが意識すべき内容となっております。

昨今クラウドインフラやデータウェアハウスの利用が企業内で当たり前になるにつれ、利用料金の肥大化と不透明性が多くの組織で深刻な課題となっています。特に、膨大なデータを処理する分析基盤においては、「気づかないうちに高額な請求が発生していた」という事態が後を絶ちません。経営層からはコスト削減の圧力がかかり、財務部門からは詳細な内訳の説明を求められる一方で、システムの複雑化によりコストのブラックボックス化は進むばかりです。

理想的なFinOps(クラウド財務管理)は、エンジニアリング部門と財務部門が協調してコスト最適化を図る状態ですが、現実には両者の間に深い断絶が存在しています。技術的な詳細を理解しない財務部門と、機能要件の達成を優先しがちな開発部門とでは、議論の前提が噛み合わないことが多いというのが現実のようです。

本記事では、Google Cloud Next 2026において語られた2つのセッションを通じて、現場のエンジニアが直面しているクラウドコスト管理の現実と、その解決策を考察します。本カンファレンスでは、新しいAPIやAIエージェントを活用することで、開発者自身がプロアクティブにコストをコントロールするための具体的な手法が示されました。データ基盤の管理やクラウドインフラの運用を担う皆様にとって、単なる設定上の小手先のテクニックではなく、設計段階からコスト意識を組み込むための理論的武装の一助となれば幸いです。

2. セッション・ハイライト:最前線では何が語られたか

セッション①「Maximize your cloud ROI: A developer’s approach to cost optimization」

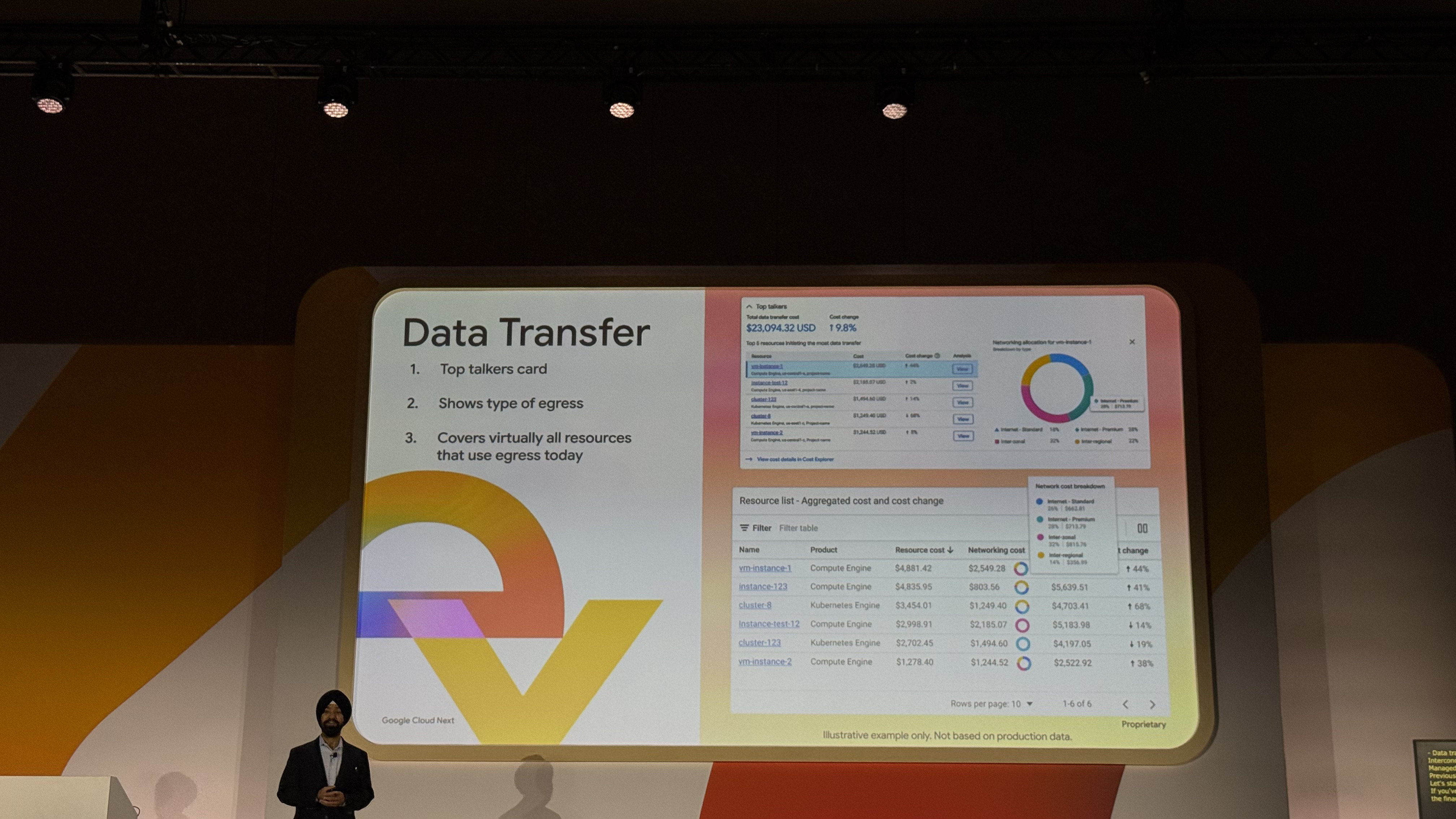

本セッションでは、エンタープライズ開発者が自らコスト管理を行うためのツール群が紹介されました 。更新された「Cloud Optimize」ダッシュボードによるBigQueryやデータ転送コストの詳細な内訳の可視化、そして「App Optimize API」によるIDEやターミナルへの直接的なデータ取り込みが実演されました。さらに、Gemini Cloud Assistを用いたAIによるコスト異常の事前検知と、インフラ変更履歴と紐づいた根本原因の自然言語解説という新たなアプローチが提示されています 。

本セッションでは、エンタープライズ開発者が自らコスト管理を行うためのツール群が紹介されました 。更新された「Cloud Optimize」ダッシュボードによるBigQueryやデータ転送コストの詳細な内訳の可視化、そして「App Optimize API」によるIDEやターミナルへの直接的なデータ取り込みが実演されました。さらに、Gemini Cloud Assistを用いたAIによるコスト異常の事前検知と、インフラ変更履歴と紐づいた根本原因の自然言語解説という新たなアプローチが提示されています 。

セッション②「Take control of your BigQuery costs: From black box to FinOps」

BigQueryのコスト増大を引き起こす具体的な要因と、その即効性のある解決策が解説されました 。エグレスコストや意図しない機能の有効化によるコストの無駄が指摘され、物理・論理ストレージモデルの選択やラベリングの重要性が語られました。また、オンデマンド料金とエディション料金の最適な使い分けや、ワークロードに応じた動的なオートスケーリングの予約変更など、インフラ管理に直結するFinOpsの実践手法が詳細に共有されています。

BigQueryのコスト増大を引き起こす具体的な要因と、その即効性のある解決策が解説されました 。エグレスコストや意図しない機能の有効化によるコストの無駄が指摘され、物理・論理ストレージモデルの選択やラベリングの重要性が語られました。また、オンデマンド料金とエディション料金の最適な使い分けや、ワークロードに応じた動的なオートスケーリングの予約変更など、インフラ管理に直結するFinOpsの実践手法が詳細に共有されています。

3. 横断的考察:セッションから浮かび上がる共通の論点

意図せぬ課金と「ブラックボックス化」の正体

【セッションで語られた実態】 両セッションに共通して語られたのは、クラウドコストの肥大化は「リソースの使いすぎ」というよりも「意図しない設定や仕様の誤認」によって引き起こされているという事実です。セッション②では、請求書に突然現れる高額な項目の多くがリージョン間をまたぐデータ転送に伴うエグレス(送信)料金や、意図せず有効化してしまった機能(DataflexやDatalineageなど)によるものあることを指摘しました。

例えば、計算リソース(US-Central 1)とデータの保存場所(USマルチリージョン)が異なるだけで、ユーザーが気づかないうちに莫大なエグレスコストが発生しています 。また、既存のテーブルにクラスタリングを追加しただけで安価な長期ストレージがリセットされてしまい、90日間にわたってストレージ料金が倍増したという手痛い失敗例も共有されました。

【現場が取るべきアプローチ】 これらの事態を防ぐためには、すべてのリソースに対する厳密なラベリング(Labeling) を組織の標準ルールとして徹底する必要があります。プロジェクト、データセット、クエリに至るまで、部門やワークロードを示すキーと値を設定することで、コストが跳ね上がった際の原因特定が容易になります。

また、システム設計の段階で物理的な配置を意識することが不可欠です。GCSバケットやBigQueryのリージョン設定が一致しているかを監査するプロセスをCI/CDパイプラインに組み込むなど、ヒューマンエラーによる設定ミスを未然に防ぐ仕組みを構築すべきです。エンジニアは機能要件を満たすだけでなく、「そのアーキテクチャがどのような課金モデルに該当するか」を常に評価する責任を持つ必要があります。

~Point~

クラウドコストの異常事態の多くは、システムの利用増ではなく、アーキテクチャ上の仕様の理解不足や設定の不一致から生じる

開発者の日常に溶け込むコスト管理(FinOpsのシフトレフト)

【セッションで語られた実態】 これまで、コスト管理は月末に財務部門から送られてくる静的なレポートに依存しがちでした。しかし、エンジニアリングリーダーの2人に1人が「財務部門とエンジニアリング部門の断絶がクラウド支出のリスクに重大な影響を与える」と考えていると語られていました。

この課題に対し、Google Cloudは開発者が普段使うツールチェーンにコストデータを統合するアプローチを提示しています。セッション①では、新たに公開された「App Optimize API」が紹介されました。

参考▶App Optimize API の概要

これにより、開発者は複雑なカスタムダッシュボードを構築することなく、最大90日間のリソースコストやCPU・メモリ使用率を、VS CodeなどのIDEやターミナルから直接クエリできるようになります 。ゲストスピーカーであるMLBのクラウドアークテクトは、Pythonスクリプトを用いてターミナル上で「過去14日間のコスト差分」を直接確認している実例を紹介しました。

【現場が取るべきアプローチ】 現場のアーキテクトや管理職は、コスト最適化を「月に1度のタスク」から「日常の開発フローの一部」へとシフトレフトさせる必要があります。APIを活用し、主要なワークロードのコスト効率レポートを日次でエンジニアにプッシュ通知するような仕組み(SlackやMicrosoft Teamsへの自動通知など)を構築することが推奨されます。

また、コストへの影響をテスト段階で把握する文化を根付かせるべきです。パフォーマンス・テストの際に、レイテンシやスループットだけでなく、「処理あたりの予想コスト」を同時に計測・可視化することで、開発者は自らのコードやクエリが財務に与える影響をリリース前に評価できるようになります。

~Point~

- 財務部門からの受動的なコスト報告を待つのではなく、エンジニア自身が開発ワークフローの中で能動的にコストを可視化・制御する「シフトレフト」の体制構築が急務となっている。

AIと自動化による「事後分析」からの脱却

【セッションで語られた実態】 コストが跳ね上がった際、その原因を特定するためにログや複数のダッシュボードを何時間も手作業で調べ回る経験は、多くのエンジニアが持っていると言えますがこの作業が「データの量と質の壁」によって数日から数週間かかることもあると指摘されていました。

これに対し、AIを活用したプロアクティブな解決策として「Gemini Cloud Assist」が提示されました。デモでは、ストレージのコストが急増した際、Geminiが監査ログと紐付けて「誰が、いつ、データのレプリケーションを実行したか」という根本原因を、自然言語で瞬時に特定・説明する様子が示されました。また、②のセッションでも、ETLジョブの実行時間(午前2時〜3時など)に合わせてBigQueryの予約スロット上限を動的に変更し、タスク終了後にスケールダウンさせるCloud Runベースの自動化策が紹介され、大手小売業がブラックフライデーでこの手法を活用している事例が語られました。

参考▶Gemini Cloud Assist: AI によるクラウドの運用と管理の支援

【現場が取るべきアプローチ】 事後対応型の監視ツールだけでは限界があります。データ活用の際は、利用状況に応じた動的なリソースのスケーリング制御 を実装しなければなりません。特に、バッチ処理やETLなど実行時間が予測可能なワークロードにおいては、Cloud SchedulerやAirflowを利用して、処理の開始前と終了後にAPI経由でキャパシティの予約枠を自動調整するパイプラインの構築が求められます。

さらに、AIエージェントの導入にあたってはAIがハルシネーションを起こさないよう、基盤となるデータ構造を整えることが重要とも再度語られていました。APIを通じて構造化されたコストデータをAIに供給することで、経営層や財務部門に対しても説得力のある正確なコストインサイトを迅速に提供できるようになります。

~Point~

- コスト増大の主因は利用過多ではなく、リージョンまたぎなどの仕様誤認にある。

- APIを用いて、IDEやターミナルなど開発者の日常環境にコスト評価を組み込む。

- 監視による事後対応から、AIと自動化スクリプトによる動的なプロビジョニングへ移行する。

4. Q&Aから見えてくるもの

コスト超過の真の要因とBIツールの落とし穴

セッション②の終盤、参加者から「フルテーブルスキャンを減らすためのベストプラクティスは何か」「お客様が犯しがちな、最も一般的でコストのかかる間違いは何か」という、現場の実務に直結する切実な質問が投げかけられました。システム設計や複雑な設定以前に、日々の運用でクエリのコストをどう抑えるかが関心事のようでした。

【登壇者の回答と、そこから読み取れること】

質問を受けた講演者は、大真面目な話として「いまだに『SELECT *』が最大の要因である」と即答しました。特にLookerやdbt、Dataformといった広く普及しているBIツールやデータ変換ツールが、デフォルトで SELECT * を実行したり、高コストなMERGE/UPDATE文を多用したりすることがコスト超過の二大要因であると率直に指摘しています 。登壇者は、パーティションフィルタを強制する設定の有効性を説きつつもインフラ側の最適化だけでは限界があり、データアナリストやBIエンジニアのクエリ実装の習慣(ツール任せの振る舞い)そのものを制御しなければならないという、ツールの利便性とコスト管理のジレンマを浮き彫りにしました。

マルチテナント環境におけるコスト配分の複雑さ

同じくセッション②にて、「BigQueryの機能構成において、コストを顧客ごとに特定することはできるか」という質問が出ました。これはSaaS提供者や、社内の複数部門にデータ基盤を共有するプラットフォームチームが抱える共通の悩みです。共有リソースのコストを、だれがどれだけ使ったかによって正確に按分(チャージバック)したいという強いニーズが現れています。

【登壇者の回答と、そこから読み取れること】

登壇者の回答は、理想と現実のギャップを示すものでした。基本的には「ラベリング」が解決策であるとしつつも、「Edition(キャパシティ料金モデル)に関してはラベルが伝播しにくいため、少し工夫が必要」と言葉を選んで回答しました 。具体的には、クエリのラベルと請求データのSKUを information_schema を用いて結合する「スロット・アトリビューション」という複雑なSQL(1,600〜1,700行にも及ぶハック)を自前で構築する必要がある実態を明かしました。Google自身もプレビュー機能で対応を進めているものの、大規模な共有基盤での厳密なコスト配分は依然として難易度が高く現場の高度なエンジニアリング力に依存していることが分かりました。

~Point~

- コストの抜け穴はインフラ設定の深部だけではなく、誰もが日常的に使うBIツールのデフォルト挙動の中にも潜んでいる。

- 共有環境での厳密なコスト按分は現行の標準機能だけでは解決が難しく、複雑な実装が求められる。

5. おわりに

本記事では、Google Cloud Next 2026のセッションから、クラウドコスト最適化のリアルな課題と最前線のアプローチを考察しました。意図せぬ設定によるコストの急増やBIツールが引き起こす無自覚なスロットの浪費など、現場にはいまだに多くの「罠」が存在しています。

しかし貴重なセッションのお陰でITアーキテクトやデータエンジニアが次にとるべきアクションが明確になりました。第一に、既存のプロジェクトやワークロードに対して徹底したラベリングを行いコストの帰属を明確にすること。

第二に、静的なレポートに頼るのではなく、新たに提供されるAPIや自動化スクリプトを用いて開発ワークフローの中にコスト評価を組み込むことです。

クラウドの柔軟性は管理を怠れば無限のコスト増大を招く諸刃の剣であることは今さら言うまでもありませんが、そのリスクに対するアクションとして【財務とエンジニアリングの壁を取り払い、AIや自動化技術を活用して「自律的なFinOps」を設計段階から組み込むこと】が、次世代のデータプラットフォームに求められる必須の要件となるのだと感じました。